算力军备竞赛 国产GPU发起冲锋

(文/李映)由ChatGPT引发的算力军备竞赛已悄然而至,在这场大模型引发的算力军备竞赛当中,GPU已成为整个行业的新焦点。在生成式AI开创的黄金时代,GPU将犹如翱翔于浩渺天空的翅膀,赋予AI大模型行业强大的推进力。

在这一场新的军备赛中,英伟达一骑绝尘,AMD紧随其后,英特尔虎视眈眈,而国产GPU厂商在经过AI的洗礼之后,加之国产替代紧迫的“引力”,不能更不应缺席这场“盛宴”。

尽管高端芯片的突围实非易事,但国产GPU能否好风凭借力,率先打破藩篱?

满足通用易用好用功能

或许,这先要从底层明了真正支撑大模型的算力需求。

天数智芯产品线邹翾表示,这要从模型和算法需求来入手,一是大模型的起点仍是小模型算法模块,针对这些模块要尽可能复用和可调试,实现兼容;二是随着参数量不断提升,GPU框架层对于大模型的拆解要考虑各种并行方式,包括计算、存储、通信的拆分;三是当多个GPU卡互联之后,出现了新的算子,需基于底层灵活的通用指令集支撑算子的调优。

考虑到这些需求,邹翾认为,GPU要满足三大要素:一是通用,可支持模型的快速变形、快速支持新算子、快速支持新通信;二是易用,可利用现有算法模块实现、调优经验可借鉴;三是好用,可重构并行计算、访存全交换、计算全互联。

实现这三大要素,背后还隐藏着芯片业运行的底层逻辑:GPU在前期巨大研发投入之后可大规模量产,具备搭建与主流兼容的生态,并使得软硬一体产品化在垂直应用中落地走向正反馈。

除这些“硬指标”之外,为满足训练集群成千上万张卡连续工作且不出故障,邹翾进一步提到,这对产品稳定性和可靠性产生极严格的要求。同时,还要支持可扩展的弹性能力,实现算力弹性可扩容。此外,还要提供坚实的保障,在故障出现时能迅速定位并快速恢复。

从国内GPU整体现状来看,与国外巨头的差距依然横亘,但经过前几年AI市场的淬炼之后,已然实现了国产通用GPU从0到1的突破,达到可用的程度。

值得一提的是,为全面助力大模型的发展,天数智芯还围绕底层技术支撑做了大量功课。邹翾介绍说,一方面天数智芯将通过最大化数据复用、可扩展大矩阵计算和存算异步、混合精度Transformer加速、高效高带宽显存及P2P等方式来提升芯片性能。另一方面,持续在基础软件方面提升实力,在支持前沿大模型、支持混合并行策略、支持新型Att加速、兼容APIs支持模型压缩等轻量化部署等层面布局。

进一步来看,应用落地是提升国产GPU实力的最佳“试验田”。邹翾提及,一方面,GPU从可用到好用还需要技术和时间积累,需要积累口碑、扩大品牌效应。另一方面,国产GPU可着力应用落地,加大与客户合作力度,在打开局面之后再逐渐扩大领地。

路径要小步快跑

要在应用中加快落地,生态是绕不过的“坎”。

目前在AI大模型领域,不仅要兼容主流生态,还要适配支持更高效、更复杂算法的大模型。

着眼于此,天数智芯率先布局,通过对高效Tensor引擎和可编程的GPGPU引擎的有机配合,硬件直接兼容主流生态,解决了通用性和高效率的双重难题。在获得量产和生态的“敲门砖”之后,天数智芯在生态层面的“朋友圈”也在持续扩大。

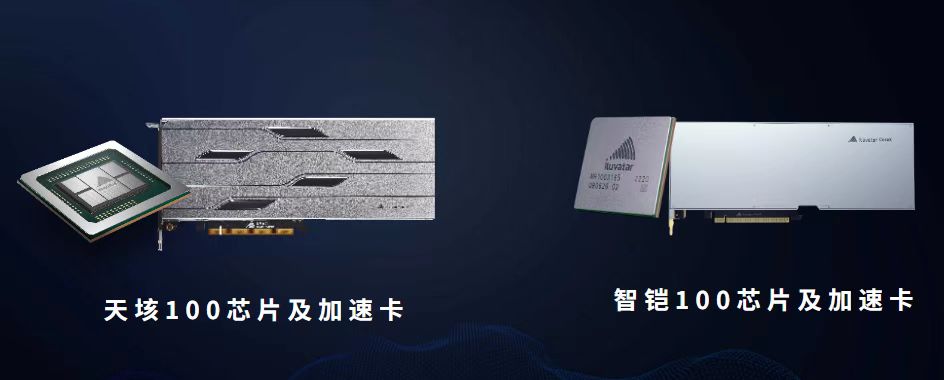

据介绍,天数智芯的通用GPU产品天垓、智铠系列具有高性能、广通用、开发成本低的特点,广泛支持DeepSpeed、Colossal、BM Train等各种大模型框架,基于其构成的算力集群方案不仅能够有效支持LLaMa、GPT-2、CPM、GLM等主流AIGC大模型的Pretrain和Finetune,还适配了清华、智源、复旦等在内的国内多个研究机构的开源项目,可以为行业伙伴提供一站式的大模型算力及赋能服务。

一系列的合作项目也捷报频传。日前天数智芯就宣布其天垓100加速卡算力集群,基于北京智源人工智能研究院70亿参数的Aquila语言基础模型,使用代码数据进行继续训练,稳定运行19天,模型收敛效果符合预期,证明天数智芯有支持百亿级参数大模型训练的能力。

前段时间,天数智芯通用GPU天垓100与飞桨已完成III级兼容性测试。测试结果显示,双方兼容性表现良好,整体运行稳定,这也是天数智芯加入“飞桨硬件生态共创计划”后的阶段性成果。

而从进阶路径来看,不能过于求大求快,而要由小及大、小步快跑。邹翾表示,国产GPU厂商可从几十上百个卡集群的推理任务入手,相比性能层面与国外产品基本持平,然后在此基础上再逐步拓展,扩展到上千或上万个卡集群,以时间换空间。

“中国在应用场景上有着自己独特的优势,很多国内头部企业也正在思考如何让大模型更好的运用起来,创造出类似“新四大发明”的独特应用,实现原生技术的通用性。”邹翾进一步建议,“因此,底层技术与市场差异化的融合将成为关键,需要国家的机制引领,以及产业链的协同创新,以共同推动全国产化进程。”

对于市场的破局,邹翾满怀信心表示,随着时间的推移,国产GPU性能不断攀升、应用全面开花,有望在5~10年实现追赶。

系统层面加以优化

随着一个个大模型相继落地,基于Transformer结构的大模型由于训练参数量级的增长致使计算需求亦量级增长,算力需求的缺口在不断扩大。

对于如何填补“缺口”的问题,邹翾从短期和长期进行了深入分析。

“对头部企业来说,早期的GPT大模型大概需要1万张的英伟达GPU,但迭代的大模型或至少需要数千张最先进的GPU才能完成。随着这一领域出现众多的跟随者,对于跟随企业来说,势必要在算力上不能输于头部企业,甚至还要进行更多的算力基础设施投资才能实现追赶。”邹翾指出,“而且现在主流产品已难以购买,算力是否充足将决定各公司大模型产品的成败。”

但从长期趋势来看,邹翾认为,现在业界掀起了百模大战,因业界尚未将大模型的性能潜力全部挖掘出来,头部企业希望能够率先抓住制高点,于是不断调高通用大模型的参数以开发新功能。但随着大模型的不断迭代,最终不可能有那么多的算力投资都真正产生效益,最终要面临落地产生闭环的考验,在未来两年内或会分出胜负,许多重复性的投资会达到收敛阈值,这时的算力基础设施需求将更趋于理性。

由于应用的爆棚和算法的快速演进,可以看到,通用GPU市场需求仍将迎来爆发式增长。据VerifiedMarketResearch数据,2020年中国大陆的独立GPU市场规模为47.39亿美元,预计2027年将超过345.57亿美元。

为加快适应这一“加速度”,邹翾还强调,业界要从系统层面来加以优化:一是大模型八九成的参数难以激活,如何让算法更简化、更高效需要持续着力;二是若做好AI大模型的算力最低门槛是1万颗英伟达A100芯片,GPU不仅要实现高算力,同时功耗至关重要,集群散热方案也十分关键;三是成本,不仅要考量GPU成本,还要考量降低存储、互联成本以及整体部署和运维成本。

在经过多年耕耘之后,天数智芯已实现了新的突破,在应用层面正步步为营,巩固了新的阵地,也为未来的持续精进打下了坚实的基石。

随着大模型需求会持续走高,最后邹翾提到,天数智芯将持续自主开发好用易用的通用GPU,不断升级算力解决方案,适配支持更高效、更复杂算法的大模型,为我国大模型创新发展和应用落地提供更加坚实的算力支撑。

*此内容为集微网原创,著作权归集微网所有,爱集微,爱原创

产业观察:透视意法与华虹合作,国产芯片成熟制程发力

专利申请

专利申请

知识产权质押融资

知识产权质押融资

专利地图分析

专利地图分析

版权登记

版权登记

集成电路布图设计

集成电路布图设计

商标交易

商标交易

商标申请

商标申请

专利交易

专利交易

专利无效

专利无效

热门评论