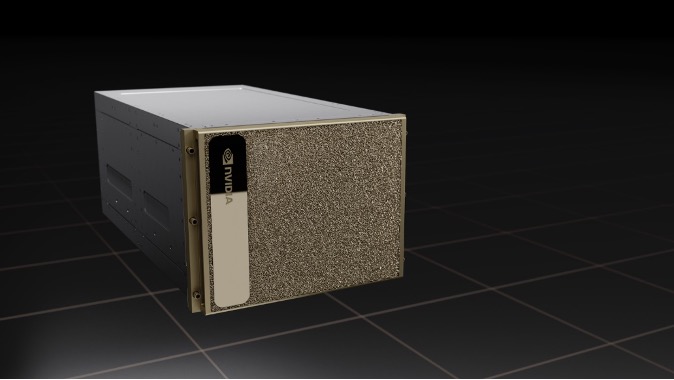

在 3 月 22 日举行的GTC 2022 主题演讲上,英伟达宣布推出第四代 NVIDIA DGX系统,这是全球首个基于全新 NVIDIA H100 Tensor Core GPU 的 AI 平台。

据了解,DGX H100 系统是新一代 NVIDIA DGX POD 和 NVIDIA DGX SuperPOD AI 基础设施平台的构建模块。新的 DGX SuperPOD 架构采用了一个全新的 NVIDIA NVLink Switch 系统,通过这一系统最多可连接 32 个节点,总计 256 块 H100 GPU。

英伟达创始人兼首席执行官黄仁勋表示:“AI 已经从根本上改变了软件的功能和产出方式。利用 AI 来革新自身所处行业的公司也意识到了自身 AI 基础设施的重要性。NVIDIA 全新 DGX H100 系统将赋能企业 AI 工厂,助力其从数据中提炼出我们最具价值的资源,即‘智能’。"

此外,英伟达还宣布推出全球运行速度最快的 AI 超级计算机 —— NVIDIA Eos。

英伟达表示,“Eos”超级计算机将于今年晚些时候开始运行,共配备 576 台 DGX H100 系统,共计 4608 块 DGX H100 GPU,有望成为全球运行速度最快的 AI 系统。

NVIDIA Eos 预计将提供 18.4 Exaflops 的 AI 计算性能,比日本的 Fugaku 超级计算机快 4 倍,后者是目前运行速度最快的系统。在传统的科学计算方面,Eos 预计将提供 275 Petaflop 的性能。

除了八块 H100 GPU 以及总计 6400 亿个晶体管之外,每个 DGX H100 系统还包含两个 NVIDIA BlueField-3 DPU,以用于卸载、加速和隔离高级网络、存储及安全服务。

借助 DGX H100 系统,DGX SuperPOD 可成为具有可扩展性的卓越的企业级 AI 中心。DGX SuperPOD 中的 DGX H100 节点和 H100 GPU 由 NVLink Switch 系统和 NVIDIA Quantum-2 InfiniBand 连接,带宽速度可达 70 TB/s,比上一代产品高 11 倍。

据了解,从第三季度起,英伟达的全球合作伙伴将开始供应 NVIDIA DGX H100 系统、DGX POD 和 DGX SuperPOD。