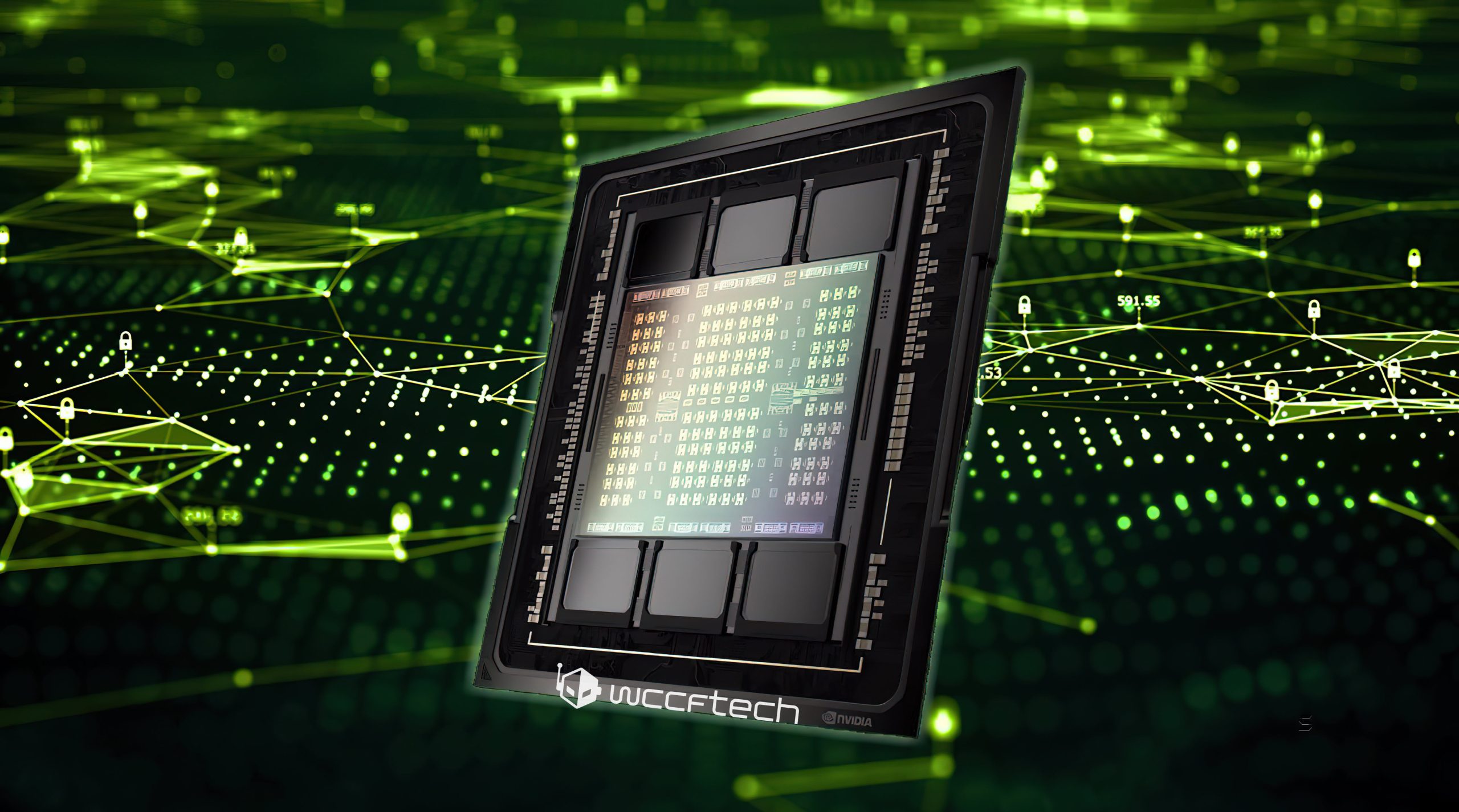

随着人工智能的飞速发展,对计算能力的需求也水涨船高。英伟达的H100目前十分热销,然而每块H100的峰值功耗高达700瓦。随着大量H100被部署,专家预测其总功耗将与一座美国大城市不相上下,甚至超过一些欧洲小国。

据预测,按照61%的年利用率,每块H100每年将消耗约3740kWh的电量。如果英伟达在2023年售出150万块H100,2024年售出200万块,到2024年底,将有350万块H100芯片被部署。这些芯片的总年耗电量将达到惊人的130.91亿千瓦时,即13091.82GWh。相比之下,格鲁吉亚、立陶宛或危地马拉等国家的年均电力消耗也大约为13092GWh。

虽然H100的功耗令人震惊,但值得注意的是,AI 和高性能计算GPU的效率正在不断提高。因此,虽然英伟达下一代Blackwell架构的B100芯片的功耗可能会超过H100,但它也将提供更高的性能,从而以更少的单位功耗完成更多工作。

显然,随着AI技术的发展,如何平衡算力与能耗之间的矛盾,将成为未来亟需解决的重要课题。